在互聯(lián)網(wǎng)信息浩瀚的海洋中,網(wǎng)絡爬蟲如同一艘艘不知疲倦的“數(shù)據(jù)漁船”,日夜不停地捕撈著公開網(wǎng)頁上的信息。它們?yōu)樗阉饕妗?shù)據(jù)分析、市場研究乃至學術探索提供了寶貴的原料。當這些“漁船”變得過于密集、航速過快,或試圖闖入本不該進入的“禁漁區(qū)”時,便會給網(wǎng)站服務器帶來沉重負擔,甚至威脅數(shù)據(jù)安全與用戶隱私。此時,互聯(lián)網(wǎng)安全服務便扮演起至關重要的“緊箍咒”角色,對爬蟲行為進行規(guī)范與約束,確保網(wǎng)絡生態(tài)的健康與平衡。

一、 爬蟲的雙面性:效率工具與潛在威脅

網(wǎng)絡爬蟲(Web Crawler)本質上是一種按照預設規(guī)則自動抓取萬維網(wǎng)信息的程序或腳本。其正面價值毋庸置疑:

- 信息聚合與索引:搜索引擎(如Google、百度)的核心即是龐大的爬蟲系統(tǒng),它們構建了互聯(lián)網(wǎng)的“地圖”與“索引”,讓信息觸手可及。

- 商業(yè)與科研分析:企業(yè)利用爬蟲監(jiān)控市場價格、收集輿情、分析競爭對手;研究人員用它獲取公開數(shù)據(jù)集,推動科學發(fā)展。

- 服務創(chuàng)新基礎:許多創(chuàng)新的互聯(lián)網(wǎng)服務,如比價網(wǎng)站、旅行聚合平臺,都依賴于高效、合法的數(shù)據(jù)采集。

不受約束的惡意爬蟲(常被稱為“網(wǎng)絡爬蟲濫用”或“Bot攻擊”)則構成了顯著威脅:

- 資源掠奪:高頻、并發(fā)的大量請求會耗盡服務器帶寬與計算資源,導致正常用戶訪問緩慢甚至服務中斷(DDoS攻擊的一種形式)。

- 數(shù)據(jù)竊取:未經(jīng)授權抓取受版權保護的內(nèi)容、個人隱私信息或商業(yè)敏感數(shù)據(jù)(如商品列表、用戶評論),用于不正當競爭或非法交易。

- 業(yè)務邏輯濫用:通過爬蟲模擬用戶操作,進行刷票、搶券、秒殺,破壞平臺的公平性與業(yè)務規(guī)則。

- 安全漏洞探測:爬蟲可能被用于自動化掃描網(wǎng)站漏洞,為后續(xù)更深入的攻擊鋪路。

二、 互聯(lián)網(wǎng)安全服務:為爬蟲戴上“緊箍咒”

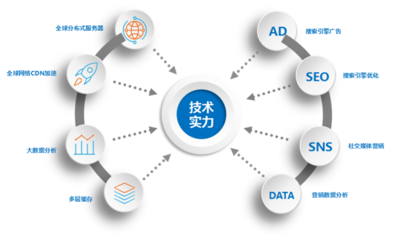

面對爬蟲帶來的挑戰(zhàn),專業(yè)的互聯(lián)網(wǎng)安全服務(如Web應用防火墻WAF、Bot管理、反爬蟲解決方案等)應運而生。它們的作用并非簡單地“一棍子打死”所有爬蟲,而是像一位智慧的“唐僧”,為“孫悟空”般的爬蟲戴上“緊箍咒”,實施精準的識別、管理與控制。其核心功能包括:

- 智能識別與分類:這是“緊箍咒”生效的前提。通過分析流量特征(如請求頻率、IP地址、HTTP頭信息、鼠標移動軌跡、JS執(zhí)行情況等),安全服務能夠精細地區(qū)分:

- 善意爬蟲:如主流搜索引擎的官方爬蟲,通常會遵守

robots.txt協(xié)議。安全服務會為其開放“綠色通道”,確保網(wǎng)站內(nèi)容被正常收錄。

- 普通自動化工具:一些用于監(jiān)控、聚合的良性工具。

- 惡意爬蟲/自動化攻擊工具:包括掃描器、 scraper、撞庫工具、垃圾信息發(fā)布工具等。

- 動態(tài)策略與挑戰(zhàn):對于可疑或惡意的流量,“緊箍咒”會啟動多種應對機制:

- 速率限制:對單一IP或會話在特定時間內(nèi)的請求數(shù)進行限制,防止資源枯竭。

- 挑戰(zhàn)響應:彈出驗證碼(如CAPTCHA)、要求執(zhí)行簡單的JavaScript計算或進行行為驗證(如滑動拼圖),以驗證訪問者是否為真實人類。高級爬蟲或許能破解簡單驗證碼,但增加了其成本和復雜度。

- 指紋識別與封禁:通過收集客戶端(瀏覽器或爬蟲框架)的獨特指紋(如Canvas指紋、WebGL指紋、字體列表等),對惡意爬蟲進行標記和長期封禁。

- 隱蔽陷阱:在網(wǎng)頁中設置對用戶不可見、但爬蟲會觸發(fā)的“蜜罐”鏈接,一旦訪問,即刻判定為惡意爬蟲。

- 合規(guī)與彈性管理:安全的“緊箍咒”也講究策略與彈性。它允許網(wǎng)站管理員自定義規(guī)則:

- 尊重

robots.txt:確保安全策略不與行業(yè)公認的排除標準沖突。

- 差異化對待:對API接口和網(wǎng)頁端可能采取不同的防護策略;對免費公開內(nèi)容和付費專區(qū)實施不同級別的保護。

- 學習與適應:基于機器學習的系統(tǒng)能夠不斷從新攻擊模式中學習,更新識別模型,實現(xiàn)動態(tài)防御。

三、 平衡之道:安全、開放與創(chuàng)新的協(xié)同

互聯(lián)網(wǎng)安全服務為爬蟲套上“緊箍咒”,其終極目的并非扼殺技術創(chuàng)新或數(shù)據(jù)流動,而是為了維護一個公平、安全、高效的網(wǎng)絡環(huán)境。這需要多方共同努力:

- 對網(wǎng)站運營者而言:應部署合適的反爬蟲措施,保護自身資產(chǎn)與用戶隱私,但同時需避免過度防護,誤傷善意爬蟲和真實用戶,影響網(wǎng)站的可訪問性和搜索引擎排名。清晰的服務條款和數(shù)據(jù)使用政策也必不可少。

- 對爬蟲開發(fā)者/使用者而言:應恪守法律與道德底線,遵守

robots.txt協(xié)議,控制請求頻率,避免對目標網(wǎng)站造成干擾。對于公開數(shù)據(jù)的利用,應尊重數(shù)據(jù)來源,考慮其承載的權益。 - 對立法與監(jiān)管而言:相關法律法規(guī)(如《數(shù)據(jù)安全法》、《個人信息保護法》及反不正當競爭相關條款)正在不斷完善,為數(shù)據(jù)抓取行為劃定紅線,為安全服務的實施提供法律依據(jù)。

爬蟲技術與互聯(lián)網(wǎng)安全服務之間的博弈,是網(wǎng)絡空間永恒的主題之一。一個健康的互聯(lián)網(wǎng)生態(tài),既需要爬蟲這類“開拓者”來連接與挖掘信息價值,也離不開安全服務這位“秩序守護者”來設定邊界、抵御濫用。這頂“緊箍咒”,不是束縛創(chuàng)新的枷鎖,而是保障航行安全的燈塔與航道規(guī)則。只有在安全、開放與創(chuàng)新之間找到精妙的平衡點,數(shù)據(jù)的浪潮才能持續(xù)滋養(yǎng)數(shù)字經(jīng)濟的發(fā)展,而非成為吞噬秩序的洪水。隨著人工智能在攻防兩端的深度應用,這場“貓鼠游戲”將更加智能化、動態(tài)化,但對公平、安全、可控的核心追求將始終不變。